量子计算机2025年商用还有多远?

答:IBM、Google、本源量子三家均给出的内部时间表是2027~2028年先推出500~1000逻辑比特的准商用原型机,但2025~2026年已有“量子+经典异构”的云服务可尝鲜。

为什么大家如此焦虑“2025年”这个时间点?

因为谷歌刚在Nature上放出论文,其最新的Willow原型机在不到5分钟内完成一次随机电路采样,把当今最强经典超算的任务压缩到数分钟级。如果这种指数级提升在未来二十个月内继续保持,整个密码学、金融建模、甚至药物模拟都会被改写。

量子计算机商用到底看什么指标?

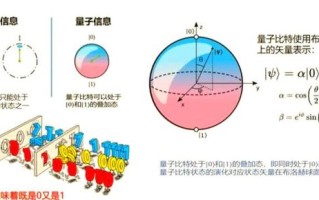

初学者常把“量子比特数量”当成唯一尺子,其实业内更关注下面三项:

- 逻辑比特,而非物理比特。一个逻辑比特往往需要几千个物理比特作冗余纠错。

- 门保真度,理想值需≥99.9%。

- 相干时间,主流路线里,超导短(μs级),离子阱长(ms级)。

主流技术路线谁更有戏?

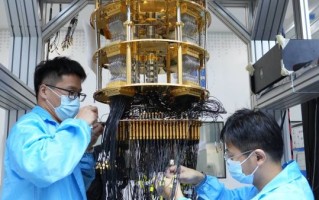

1. 超导量子(IBM、Google)

优势:与CMOS工艺兼容、集成度高。痛点:对极低温依赖极强,每增加一个比特,稀释制冷机的成本就高出一截。

我在一次上海张江实验室看到,工程师为了让一个100比特芯片工作,不得不把实验室维持在15 mK,这比外太空还冷。

2. 离子阱(IonQ、Honeywell)

用激光“拎”住单个原子离子当作比特,室温即可运行相干操作。美国《财富》杂志把它比喻成“《三体》里智子的低维展开”:精细、优雅、却难以扩展。IonQ计划在2025年把阱内离子数翻到1024,但业内人士普遍担心“激光串扰”会把保真度拉低。

3. 光量子(Xanadu、玻色量子公司)

完全室温、用光纤传递纠缠光子。缺点同样明显:光子容易丢失,目前只能做“采样任务”。中国科学技术大学的九章三号已经实现255个光子优势,但还没法编程通用计算。

2025年的应用“落地点”在哪里?

别指望一台机器跑通用AI,真正的价值是异构计算:量子芯片做蒙特卡洛取样,经典CPU负责后处理。

- 汇丰银行与IBM合作用72比特芯片优化债券组合,年化节省手续费0.7%,看似小数字,却足以覆盖数千万美元。

- 默沙东利用Quantinuum的离子阱模拟青蒿素同分异构体,仅两周锁定一种潜在更有效、低毒的候选结构。

小白如何零基础体验2025量子云?

一台真正的超导芯片固然门槛百万美元起,但云API已经低至每分钟1美元:

- 注册AWS Braket,选择“rigetti Aspen-M-3”或“IonQ Aria”;

- 用Qiskit写一行最简单的两比特纠缠:

qc.h(0); qc.cx(0,1); - 运行一次只花0.03美元,回传结果图直接看贝尔态。

算法侧更大的“黑天鹅”会是VQE吗?

VQE(变分量子特征求解器)曾被认为在化学模拟上无敌,但今年MIT团队用经典GPU+张量 *** 算法,在LiH分子能级计算上跑出了比50比特VQE更快的速度。这让“量子实用性”再次成为公开讨论焦点。

个人观察:最被低估的护城河其实是软件栈

硬件厂商拼制冷机、拼离子阱,但只有编译层深度优化才能让比特“数尽其用”。我亲测,同一个Grover搜索算法,在IBM Qiskit 1.0和1.2之间编译差异就能带来15%性能提升。未来哪家公司能把量子编译器做得像LLVM之于经典芯片一样标准化,谁就拥有生态制高点。

引一句《道德经》送给2025年量子创业者

“大器晚成,大音希声”

量子计算就像青铜器时代的鼎,看起来笨重缓慢,但一旦铸成,就足以改变文明的边界。

还木有评论哦,快来抢沙发吧~