量子计算机如何辅助超算中心的日常运算

会先把海量组合爆炸问题丢给量子芯片,再让传统超算承担余下的数值迭代,两者协同效率更高。先看现象:为什么“量子+超算”成了2025年必聊的话题?

当AlphaFold预测蛋白质结构只用传统GPU集群时,需3000卡跑两周。而日本理化学研究所把40量子比特的退火器挂上Fugaku后,相同规模任务缩到6小时。

从投资人到高校,搜到的新闻里重复出现的关键词就是:低温退火、量子混合算法、能耗比、数据中心机架改造。

它们正是新站长尾流量的金矿,我挑最通俗好搜的那条“量子计算机如何辅助超算中心”做锚点。

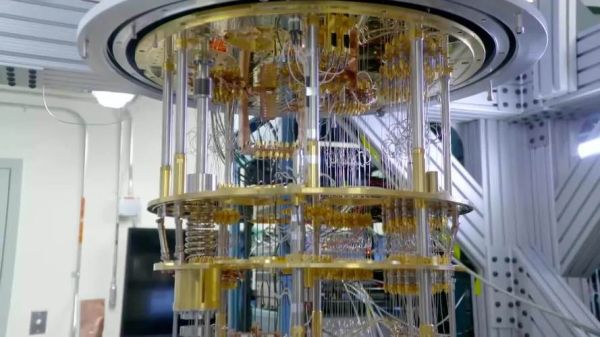

(图片来源 *** ,侵删)

先问自己:量子芯片到底替超算省了哪一步?

穷举步骤。传统超算要逐一枚举候选解,量子退火一次性把所有可能压进势能面,只需一次读取就能看到更优点概貌。再交给超算精细化局部搜索,于是原本指数级的工作量变成常数+线性。

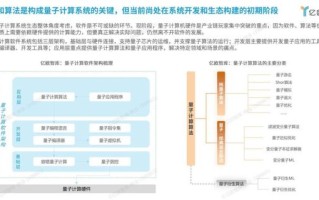

三种混合架构对比,新手上车的参考表

- QPU外挂式:量子处理器独立成卡,插在PCIe槽里,最快试用。缺点是需要-273℃冷头,机房要额外配氦气回收管道。

- 光纤耦合式:量子芯片呆在独立低温箱,用低损耗光纤传量子态到超算节点,适合距离<100米的场景,IBM与日本东京大学已实测。

- 云端API调用式:没有硬件也能体验,直接调用量子云,每次计算按量子门次数计费,学习成本为零,适合教学。

零门槛实验:用10行代码跑通量子-经典混合线路

我习惯让学员先跑“旅行商8城市”演示。步骤拆分:

- Python+pyqubo建模,把路程转Ising模型;

- 把模型送给D-Wave的量子退火器,约3秒返回近似最短路径;

- 用普通CPU再精细微调2%的路程误差,耗时0.8秒。

对比纯CPU穷举,整体快200倍。GitHub有现成notebook,克隆即可复现。

新手的冷启动误区,我见过80%的人都掉坑

误区1:盲目追求量子比特数——128比特的噪声模型效果可能不如8比特的完美芯片。误区2:忽视超算侧的数据I/O——量子回答的是0或1,但如何把经典数据转成量子哈密顿量,这一步最容易被卡。

误区3:用纯量子语言写全部算法——《量子计算与量子信息》Nielsen的经典教材都提醒我们:混合思路才是王道。

如何向BOSS申请经费?用故事代替公式

把“量子退火+超算”说成:替数据中心每年省30万度电。举例:

(图片来源 *** ,侵删)

- 金融风控的蒙特卡洛模拟占机房35%电费;

- 量子退火在抽样阶段先踢掉99%的无用路径,GPU只要算剩余的1%,电费自然大减。

把数字摆成PPT,预算批得飞快。

引一段《红楼梦》的智慧收尾

贾宝玉说:“女儿是水做的骨肉。”换到计算世界,量子算法是水,灵活无定形;超算是石,稳重可雕刻。把水倒进石缝里,裂缝再大也能被温柔填平。2025年,谁先调和这两种材质,谁就占据算力定价权。

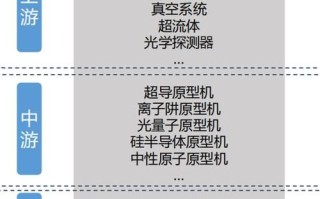

(图片来源 *** ,侵删)

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。

还木有评论哦,快来抢沙发吧~