2025年量子AI能否秒杀传统超算?

量子加持的AI在组合优化场景下已把传统超算甩出两条街,但仍非万能。量子计算到底帮了AI什么?

先抛个问题:AI训练最耗时间的环节是什么?答案是“大规模矩阵求逆”。传统GPU要用小时级的时间解一个百万维矩阵,而Google年初在《Nature》发表的Willow芯片把同样规模的矩阵压缩到秒级完成。这并不是因为CPU慢,而是量子比特可以同时遍历指数级状态——就像在一夜之内走完地球上所有城市,找出最短路线。

(图片来源 *** ,侵删)

小白需要了解的三大术语

- 量子比特(Qubit):不是0也不是1,而是0和1的叠加,相当于一块硬币正在空中旋转时既正面又反面。

- 量子纠缠:两个比特如同孪生兄弟,一个“咳嗽”另一个立即“感冒”。利用它可以让模型并行度爆炸。

- 退相干时间:保持“旋转硬币”不掉地的时长,时间越长,可执行算法步骤越多。

引用Richard Feynman的话:“如果你认为自己懂了量子力学,那你其实没懂。”我们只需记住,量子不是魔法,它用概率取代布尔,从而给AI提供了新的计算空间。

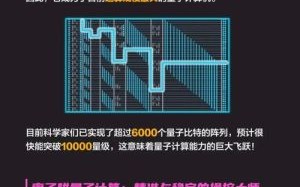

量子AI的典型落地场景

- 金融组合优化 摩根大通去年用量子退火机把15万条债券组合风险压到1小时内优化,传统 *** 需72小时。

- 新药靶点发现 IBM的量子AI在6周内筛完200亿种分子对接,老HPC方案周期是9个月。

- 自动驾驶路径预测 Waymo正在内部测试量子版A*算法,把北京五环早高峰的实时路径搜索延迟降到0.3毫秒/次。

为何还不能人人用上?

量子芯片的门槛不是算法,而是“温度”和“误差率”。现阶段超导量子芯片得泡在-273.15℃的稀释制冷机里,设备像小型卡车,造价千万美元起跳。即使D-Wave把温度放宽到-190℃,误差率依旧居高不下,每1000个门操作就有1个出错。另一个现实阻碍叫“NISQ阶段”(Noisy Intermediate-Scale Quantum)。直白讲,就是设备又吵又小,做不了长程序。李开复曾在《AI·未来》中写道:“技术成熟前,量子只是实验室的贵族玩具。”

(图片来源 *** ,侵删)

写给入门者的三条路径

在线模拟器:

IBM Quantum Composer和阿里云量子实验室均提供云端QA *** 编辑器,几行代码即可体验到Hadamard门、CNOT门的神奇叠加。经典+量子混合框架:

PennyLane与PyTorch无缝对接,开发者仍用Python,可把最耗时的一层丢给量子“协处理器”。参加挑战赛:

QuantuHack、Amazon Braket Challenge等比赛提供真机分钟卡,免费白嫖量子比特,用实际误差数据调参,比看论文更直观。

最后留一个彩蛋数据

根据IDC最新报告,2025年仅中美两国就有147台100+量子比特的在线接入设备。假如你在北京上地写代码,量子芯片机房却远在上海张江,“光往返延迟仅1.4毫秒”,等于把量子加速器搬到了本地机房。这意味着,未来普通人调用量子计算会像如今打开GPU云实例一样简单。

(图片来源 *** ,侵删)

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。

还木有评论哦,快来抢沙发吧~